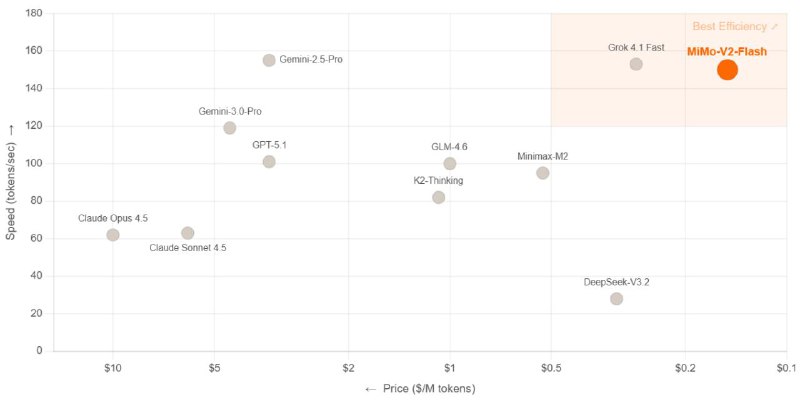

Xiaomi наконец-то попали в цель со своим MiMo-V2-FlashЭто open-source LLM, которая оказалась на одном уровне с популярными нейронками, где 309B параметров, 15B активных (MoE), с контекстом в 256k токенов.

Заточена под reasoning, код и агентские штуки:

на SWE-bench — 73,4% (лучший результат среди open-source, уровень GPT-5 High);

на AIME 2025 — 94,1%;

режим «размышления» можно включить или выключать, в зависимости от задачи.

Скорость и цена:

150 токенов/сек;

$0,1 / 1M input, $0,3 / 1M output;

ускорение инференса до 2,6× за счёт хитрого декодинга.

Внутри — Multi-Token Prediction, sliding window attention и новый post-training: <1/50 вычислений от классического SFT+RL пайплайна при сопоставимом качестве.

MIT-лицензия и пока что бесплатный API.

Редкий случай, когда большая модель получилась не только умной, но и экономной.

Полезные ссылки:

API / официальный блог / HuggingFace

#ml

10K views14:47