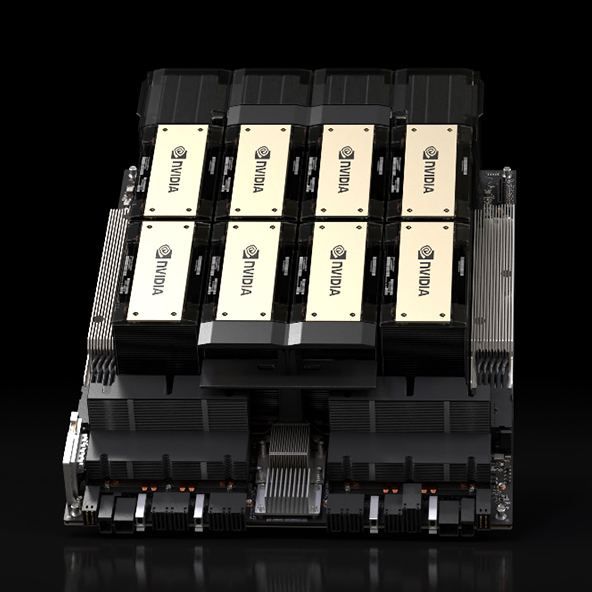

Nvidia представила самый мощный ускоритель для искусственного интеллекта — H200.

Он использует новый тип памяти HBM3e на 141 ГБ с пропускной способностью 4,8 ТБ/с, в то время как у предыдущей модели H100 было только 80 ГБ и 3,35 ТБ/с.

H200 увеличивает скорость вывода в два раза по сравнению с H100 при работе с большими языковыми моделями, такими как Llama2. Это означает, что можно получить более точные и полезные ответы от ИИ.

Ускоритель будет доступен только в середине 2024 года, а пока Nvidia продолжит поставлять H100.

Ждем скачок развития чат-ботов.