2024-04-30 14:22:37

Новое обновление про полезные локальные модели:

Вчера вышла версия llama-3-8b с контекстным окном в 1 миллион токенов (!). Это значит, что задачи анализа большого количества текста можно теперь делать локально (точно на английском, с другими языками я это не тестил), до этого я ходил в Claude 3 Opus 200k.

Зачем это нужно?

Расскажу на живом примере: мы готовим новый продукт к анонсу, это что-то вроде AI фото студии но на вход мы берем всего одно фото пользователя, не 10-20; что сильно дешевле чем файнтюн модели дримбудкой, а значит, мы можем снизить цену на продукт для юзеров.

У продукта уже есть конкуренты — это классно, потому что это значит, что в нише есть выручка. Конкуренты уже успели обрасти органическим трафиком – это мы и учитываем при запуске нового продукта:

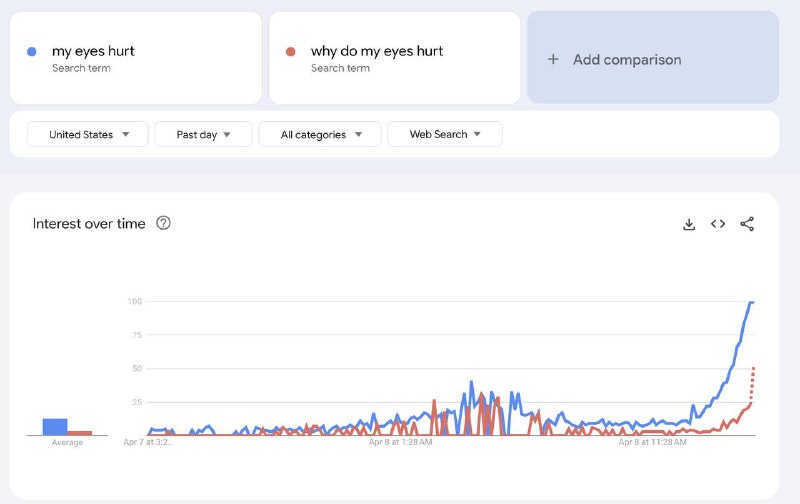

Я выгрузил из SEO анализатора органический трафик по которому находят наших конкурентов в гугле, скормил все это в контекстное окно как часть промпта и запросил у LLM популярные стили генераций, по которым пользователи ищут наших конкурентов.

В итоге, на запуске, мы получили топ-10 стилей которые точно востребованы в интернете.

Ради теста я сравнил результаты своего анализа между Claude 3 Opus 200k и Llama-3-8B-Instruct-Gradient-1048k, и могу сказать что локальная модель отлично справилась для своего размера и действительно смогла написать важные стили, похожие на то что выдал Opus. Так что теперь вы можете делать анализ больших корпусов текста дома.

Сама модель тут (gguf версия для адептов llama.cpp)

P.S. Для этой задачи важно ставить температуру 0, а то напридумывает деталей моделька. Указывая контекстное окно в 100k+ будьте готовы что памяти компа вам не хватит.

P.P.S. Как водится, делюсь промптом который специально собрал для llama3 формат под эту задачу, там видно куда нужно поместить большой объем текста.

#пропродукт

29.7K viewsedited 11:22